AIPM要知道的NLP知识(1):词的表达

编辑导语:NLP为Neuro-Linguistic Programming的缩写,是研究思维、语言和行为中的纪律;这是一种对优秀(excellence)举办编码和复制的 *** ,它能使你不绝到达你和你的公司想要的功效;本文是作者关于NLP常识中词的表达的分享,我们一起来看一下。

小我私家认为pm懂一点技能长处是大大的有。

总结这个系列,把NLP相关的常见模子举办了梳理,分为词的表达、RNN、seq2seq、transformer和bert五个部门。

根基的想法是重点领略模子是什么(what)、为什么要用这种模子(why)以及哪些场景中可以用这种模子(where),至于如何实现模子(how)可以留给RD小哥哥们。

一、词的表达要知道计较机是看不懂人类语言的,要想让呆板领略语言、实现自然语言处理惩罚,之一步就是把自然语言转化成计较机语言——数字。

由于词是人类语言表达时的一种根基单元(虽然更细的单元是字可能字母),NLP处理惩罚的时候很自然的想要用一组特定的数字代表一个特定的词,这就是词的表达,把这些暗示词的数字连起来就可以表达一句话、一篇文章了。

这一part里有许多常见的名词,distributed representation、word embedding、word2vec等等,它们的干系或许是这样的:

表达 *** ,我以为就是自然语言到呆板语言怎么转化的一套法则;好比“我”这个词转化到呆板语言应该用“1”照旧“100”暗示呢?并且呆板语言中代表“我”的这个数还不能和代表其他词的数反复吧,必需是一个独一的id。

顺着id这个思路,假设我们的辞书收录了10个词,那么我们就给辞书里的每一个词分派一个独一的id;词暗示的时候用一个和字典一样长的向量暗示,这个向量里只有id这一位为1,其他位都为0;好比说abandon这个词的id是1,那么就暗示成abandon=[1 0 0 0 0 0 0 0 0 0],这就是one-hot representation。

这种暗示好领略,可是也有问题:

问题一:向量会跟着字典变大而变大。

很明明假如我的辞书有100000个词的话,每一个词都要用长度100000的向量暗示;假如一句话有20个词,那么就是一个100000*20的矩阵了,按这种操纵根基就走远了。

别的一个问题是这种暗示不能浮现语义的相关性。

好比香蕉和苹果在人看来长短常雷同的,可是用one-hot暗示香蕉大概是[1,0,0,0,0],苹果大概是[0,0,1,0,0],之间没有任何相关性;这样的话假如我们用“我吃了香蕉”练习模子,功效模子大概并不能领略“我吃了苹果”,泛化本领就很差。

于是机警的大佬们提出了一个假说,就是distributed hypothesis:词的语义由其上下文抉择。

基于这种假说生成的暗示就叫做distributed representation,用在词暗示时也就是word embedding,中文名有词向量、词嵌入;所以distributed representation≈word embedding,因为现阶段主流的nlp处理惩罚多半是基于词的,虽然也有对字、句子、甚至文章举办embedding的,所以不能说完全完全相等。

至于详细如何基于这种假说实现词暗示,按照模子差异可以分成基于矩阵(GloVe)、基于聚类、基于神经 *** (NNLM、Word2Vec等)的要领。

2. word embedding小我私家领略,从字面意思上看word embedding就是把一个one-hot这样的稀疏矩阵映射成一个更浓密的矩阵;好比上边栗子中abandon用one-hot(辞书巨细为10)暗示为[1 0 0 0 0 0 0 0 0 0];但word embedding大概用维度为2的向量[0.4 0.5]就可以暗示;办理了前边说的one-hot的维渡过大问题,还增大了信息熵,所以word embedding暗示信息的效率要高于one-hot。

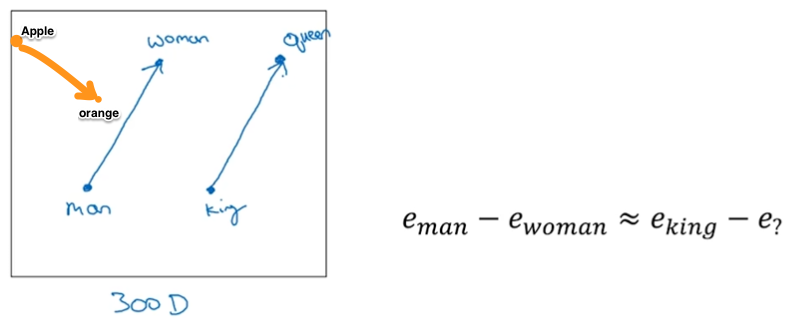

但词向量这个名字没有浮现出它暗示语义的本质,所以之一次看到很容易会不知所云;为了说明word embedding可以浮现语义,这时候就可以搬出著名的queen、king、woman、man的栗子了。

(图来自Andrew Ng deeplearning.ai)

上图是通过练习得出的词向量,man=[-1 0.01 0.03 0.09],woman=[1 0.02 0.02 0.01],king=[-0.95 0.93 0.70 0.02],queen=[0.97 0.95 0.69 0.01]。

矩阵相减man-woman=[-2 -0.01 0.01 0.08],king-queen=[-1.92 -0.02 0.01 0.01],两个差值很是临近,可能说两个向量的夹角很小,可以领略为man和woman之间的干系与king和queen之间很是临近;而apple-orange=[-0.01 -0.01 0.05 -0.02]就和man-woman、king-queen相差很大。

很有意思的是最初word embedding其实是为了练习NNLM(Neural Network Language Model)获得的副产物。

相关文章

从内容监管策略到职业发展建议,产品经理都关心的5大问题

新浪微博热搜停更一周成为了热点话题,引起了行业重视。关于内容禁锢的接头热度居高不下,本文从五个方面探讨内容禁锢到底该怎么做,而且就产物司理感乐趣的职业成长问题提出发起,但愿对你有辅佐。 克日新浪...

产品经理,如何降噪学习?

编辑导语:如今在这个互联网横行的时代,我们已经很难静下心来进修和事情,手机里的新资讯不断的诱惑着我们去点一点、看一看;但其实抹去那些我们的进修效率和事情效率也会提高许多,本文作者具体先容了降噪进修,我...

用户留存 Retention:资本寒冬的内功修为

曾几何时,互联网企业烧钱圈地,何其风光,但随着推广价格不断上涨,烧钱拓展业务的效率越来越低。如今更是碰上资本寒冬,地主家也没有余粮的时代,大家一分钱掰成两半用,企业转而修炼内功,期望业务增长就必然会涉...

3个维度,重新定义用户体验(一)

编辑导语:在许多方面都存在用户体验,但许多时候是站在产物的角度举办阐明,这只是一部门;用户体验还要从用户的感觉和感情出发,更精确的掌握好用户的需求;本文作者从三个维度从头界说了用户体验,我们一起来看一...

好希望2020过去的四分之一,都是愚人节

2020已经过去的四分之一,假设它能换种模式重启,或许会是这样的: • 假设疫情没有发生,所有人都能平安健康的过个团圆年; • 假设网络上没有让人焦虑的新闻和谣言,大家继续刷着八卦和明星; • 假设...

PRD:倒推“每日优鲜”app产品需求文档

疫情过后,线上买菜会成为趋势吗?每日优鲜作为一个比较成熟的O2O生鲜电商平台,我根据现有的每日优鲜app进行了文档倒推,对产品结构、主要业务流程、主要窗口的页面逻辑和交互进行了简要的分析和说明。 该文...

免责声明:本站所发布的任何网站,全部来源于互联网,版权争议与本站无关。仅供技术交流,如有侵权或不合适,请联系本人进行删除。不允许做任何非法用途!

免责声明:本站所发布的任何网站,全部来源于互联网,版权争议与本站无关。仅供技术交流,如有侵权或不合适,请联系本人进行删除。不允许做任何非法用途!